Ngày 22 tháng 6 năm 2023Tin tức về hacker

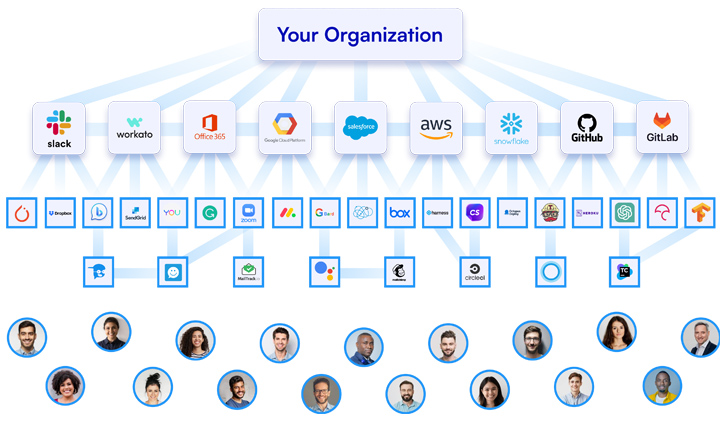

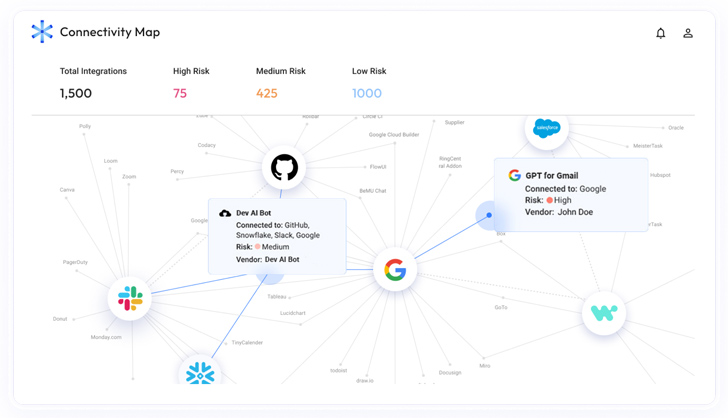

Mất ngủ vì các ứng dụng Generative-AI? Bạn không đơn độc hay sai. Theo Nhóm nghiên cứu bảo mật Astrix, trung bình các tổ chức quy mô trung bình đã có 54 tích hợp Generative-AI cho các hệ thống cốt lõi như Slack, GitHub và Google Workspace và con số này dự kiến sẽ tăng lên. Tiếp tục đọc để hiểu những rủi ro tiềm ẩn và cách giảm thiểu chúng.

“Xin chào ChatGPT, xem xét và tối ưu hóa mã nguồn của chúng tôi”

“Xin chào Jasper.ai, hãy tạo một email tóm tắt về tất cả các khách hàng mới ròng của chúng tôi trong quý này”

“Này Otter.ai, tóm tắt cuộc họp hội đồng quản trị Zoom của chúng tôi”

Trong thời đại hỗn loạn tài chính này, các doanh nghiệp cũng như nhân viên không ngừng tìm kiếm các công cụ để tự động hóa quy trình làm việc, đồng thời tăng hiệu quả và năng suất bằng cách kết nối các ứng dụng của bên thứ ba với các hệ thống kinh doanh cốt lõi như Google workspace, Slack và GitHub thông qua khóa API, mã thông báo oauth, dịch vụ tài khoản và hơn thế nữa. Sự gia tăng của các ứng dụng Generative-AI và dịch vụ GPT càng làm trầm trọng thêm vấn đề này, với việc nhân viên của tất cả các bộ phận nhanh chóng bổ sung các ứng dụng AI mới nhất và tốt nhất vào kho vũ khí năng suất của họ mà nhóm bảo mật không hề hay biết.

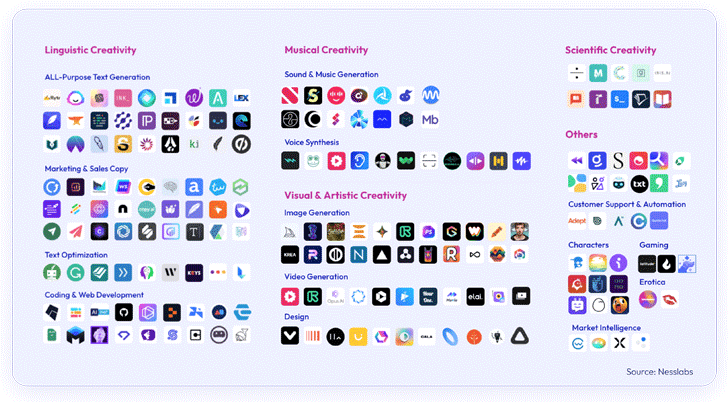

Từ các ứng dụng kỹ thuật như đánh giá và tối ưu hóa mã đến các ứng dụng tiếp thị, thiết kế và bán hàng như tạo nội dung & video, tạo hình ảnh và ứng dụng tự động hóa email. Với việc ChatGPT trở thành ứng dụng phát triển nhanh nhất trong lịch sử và các ứng dụng hỗ trợ AI được tải xuống nhiều hơn 1506% so với năm ngoái, các rủi ro bảo mật khi sử dụng và thậm chí tệ hơn là việc kết nối các ứng dụng thường chưa được kiểm tra này với các hệ thống cốt lõi của doanh nghiệp đã gây ra những đêm mất ngủ cho bộ phận bảo mật lãnh đạo.

Rủi ro của ứng dụng Gen-AI

Các ứng dụng dựa trên AI đưa ra hai mối quan tâm chính đối với các nhà lãnh đạo bảo mật:

1. Chia sẻ dữ liệu qua các ứng dụng như ChatGPT: Sức mạnh của AI nằm ở dữ liệu, nhưng chính điểm mạnh này có thể trở thành điểm yếu nếu quản lý sai. Nhân viên có thể vô tình chia sẻ thông tin nhạy cảm, quan trọng đối với doanh nghiệp bao gồm PII của khách hàng và tài sản trí tuệ như mã. Những rò rỉ như vậy có thể khiến các tổ chức bị vi phạm dữ liệu, gây bất lợi trong cạnh tranh và vi phạm tuân thủ. Và đây không phải là một câu chuyện ngụ ngôn – chỉ cần hỏi Samsung.

Rò rỉ Samsung và ChatGPT – một trường hợp cần thận trọng

Samsung đã báo cáo ba vụ rò rỉ thông tin nhạy cảm cao khác nhau bởi ba nhân viên đã sử dụng ChatGPT cho mục đích năng suất. Một trong số các nhân viên đã chia sẻ mã nguồn bí mật để kiểm tra lỗi, một mã được chia sẻ khác để tối ưu hóa mã và người thứ ba chia sẻ bản ghi cuộc họp để chuyển đổi thành ghi chú cuộc họp cho bản trình bày. Tất cả thông tin này hiện được ChatGPT sử dụng để đào tạo các mô hình AI và có thể được chia sẻ trên web.

2. Các ứng dụng Generative-AI chưa được xác minh: Không phải tất cả các ứng dụng AI tổng quát đều đến từ các nguồn đã được xác minh. Nghiên cứu gần đây của Astrix tiết lộ rằng các nhân viên đang ngày càng kết nối các ứng dụng dựa trên AI này (thường có quyền truy cập đặc quyền cao) với các hệ thống cốt lõi như GitHub, Salesforce, v.v. – gây ra những lo ngại đáng kể về bảo mật.

Đặt phiên Khám phá Trí tuệ nhân tạo-AI với các chuyên gia của Astrix Security (miễn phí – không ràng buộc – không cần tác nhân & không ma sát)

Ví dụ thực tế về tích hợp Gen-AI đầy rủi ro:

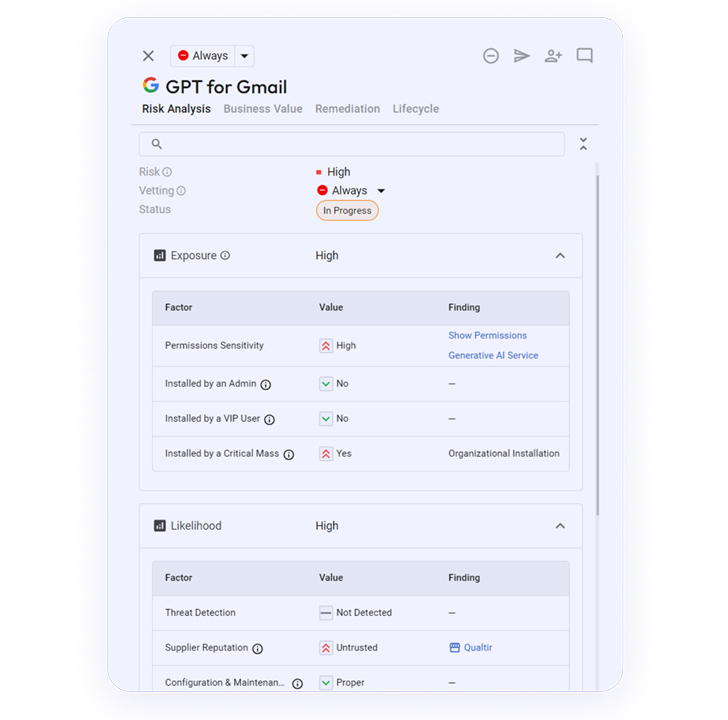

Trong các hình ảnh bên dưới, bạn có thể xem thông tin chi tiết từ nền tảng Astrix về tích hợp Gen-AI đầy rủi ro kết nối với môi trường Google Workspace của tổ chức.

Tích hợp này, Tích hợp Google Workspace “GPT cho Gmail”, được phát triển bởi một nhà phát triển không đáng tin cậy và được cấp quyền cao đối với tài khoản Gmail của tổ chức:

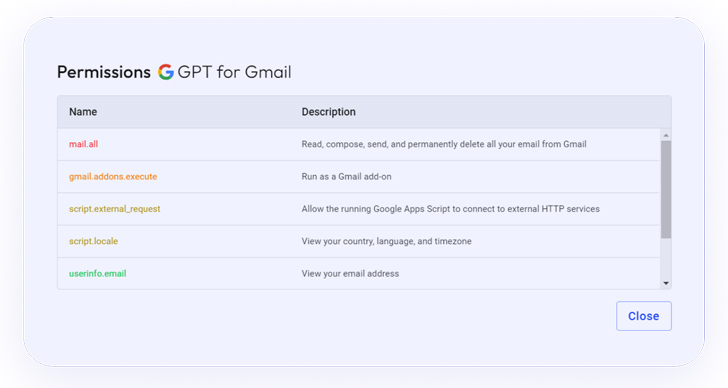

Trong số các phạm vi quyền được cấp cho tích hợp là “mail.all”, cho phép ứng dụng bên thứ ba đọc, soạn, gửi và xóa email – một đặc quyền rất nhạy cảm:

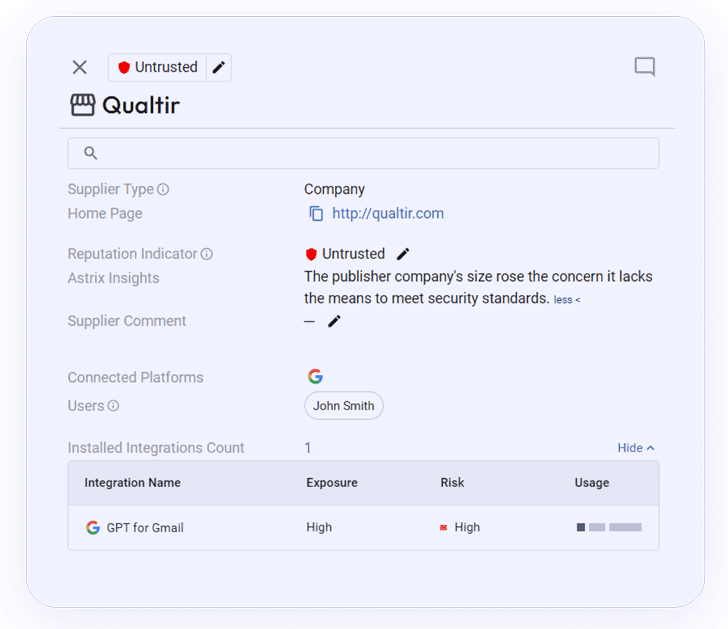

Thông tin về nhà cung cấp của tích hợp, không đáng tin cậy:

Làm sao ma quỷ giúp giảm thiểu rủi ro AI của bạn

Để điều hướng một cách an toàn trong bối cảnh thú vị nhưng phức tạp của AI, các nhóm bảo mật cần quản lý danh tính phi con người mạnh mẽ để có được khả năng hiển thị các dịch vụ bên thứ ba mà nhân viên của bạn đang kết nối, cũng như kiểm soát quyền và đánh giá chính xác các rủi ro bảo mật tiềm ẩn. Với Astrix, giờ đây bạn có thể:

Đặt phiên Khám phá Trí tuệ nhân tạo-AI với các chuyên gia của Astrix Security (miễn phí – không ràng buộc – không cần tác nhân & không ma sát)