Các nhóm bảo mật và CNTT thường xuyên bị buộc phải áp dụng phần mềm trước khi hiểu đầy đủ các rủi ro bảo mật. Và các công cụ AI cũng không ngoại lệ.

Các nhân viên cũng như các nhà lãnh đạo doanh nghiệp đang đổ xô vào phần mềm AI tổng quát và các chương trình tương tự, thường không biết về các lỗ hổng bảo mật SaaS chính mà họ đang đưa vào doanh nghiệp. Một cuộc khảo sát về AI tổng quát vào tháng 2 năm 2023 với 1.000 giám đốc điều hành đã tiết lộ rằng 49% số người được hỏi hiện đang sử dụng ChatGPT và 30% dự định sẽ sớm sử dụng công cụ AI tổng quát phổ biến này. 99% những người sử dụng ChatGPT đã tuyên bố một số hình thức tiết kiệm chi phí và 25% đã chứng thực việc giảm chi phí từ 75.000 đô la trở lên. Vì các nhà nghiên cứu đã tiến hành khảo sát này chỉ ba tháng sau khi ChatGPT ra mắt rộng rãi, nên việc sử dụng công cụ AI và ChatGPT ngày nay chắc chắn cao hơn.

Các nhóm bảo mật và rủi ro đã quá tải để bảo vệ tài sản SaaS của họ (hiện đã trở thành hệ điều hành của doanh nghiệp) khỏi các lỗ hổng phổ biến như cấu hình sai và người dùng quá quyền. Điều này để lại ít băng thông để đánh giá bối cảnh mối đe dọa của công cụ AI, các công cụ AI chưa được cấp phép hiện đang được sử dụng và các tác động đối với bảo mật SaaS.

Với các mối đe dọa đang nổi lên bên ngoài và bên trong các tổ chức, CISO và nhóm của họ phải hiểu những rủi ro liên quan nhất đến công cụ AI đối với các hệ thống SaaS — và cách giảm thiểu chúng.

1 — Các tác nhân đe dọa có thể khai thác AI sáng tạo để đánh lừa các giao thức xác thực SaaS

Khi những nhân viên đầy tham vọng nghĩ ra cách để các công cụ AI giúp họ đạt được nhiều thành tích hơn với chi phí ít hơn, thì tội phạm mạng cũng làm như vậy. Việc sử dụng AI tổng hợp với mục đích xấu đơn giản là điều không thể tránh khỏi và điều đó đã có thể xảy ra.

Khả năng đóng giả con người cực kỳ tốt của AI khiến các giao thức xác thực SaaS yếu đặc biệt dễ bị tấn công. Theo Techopedia, các tác nhân đe dọa có thể lạm dụng AI tổng quát để đoán mật khẩu, bẻ khóa CAPTCHA và xây dựng phần mềm độc hại mạnh hơn. Mặc dù các phương pháp này nghe có vẻ hạn chế trong phạm vi tấn công của chúng, nhưng Tháng 1 năm 2023 Vi phạm bảo mật CircleCI được cho là do máy tính xách tay của một kỹ sư bị nhiễm phần mềm độc hại.

Tương tự như vậy, ba học giả công nghệ nổi tiếng gần đây đã đặt ra một giả thuyết hợp lý về việc AI tổng quát thực hiện một cuộc tấn công lừa đảo:

“Một tin tặc sử dụng ChatGPT để tạo một tin nhắn lừa đảo trực tuyến được cá nhân hóa dựa trên các tài liệu tiếp thị của công ty bạn và các tin nhắn lừa đảo đã thành công trong quá khứ. Nó đã thành công trong việc đánh lừa những người đã được đào tạo bài bản về nhận thức email, bởi vì nó trông không giống giống như những thông điệp mà chúng đã được đào tạo để phát hiện.”

Các tác nhân độc hại sẽ tránh điểm vào kiên cố nhất — điển hình là chính nền tảng SaaS — và thay vào đó nhắm mục tiêu vào các cửa phụ dễ bị tấn công hơn. Họ sẽ không bận tâm đến chốt cửa và con chó bảo vệ nằm ở cửa trước khi họ có thể lẻn quay trở lại cửa hiên không khóa.

Chỉ dựa vào xác thực để giữ an toàn cho dữ liệu SaaS không phải là một lựa chọn khả thi. Ngoài việc triển khai xác thực đa yếu tố (MFA) và khóa bảo mật vật lý, các nhóm bảo mật và rủi ro cần có khả năng hiển thị và giám sát liên tục cho toàn bộ chu vi SaaS, cùng với cảnh báo tự động cho hoạt động đăng nhập đáng ngờ.

Những hiểu biết sâu sắc này không chỉ cần thiết cho các hoạt động AI tổng quát của tội phạm mạng mà còn cho các kết nối công cụ AI của nhân viên với các nền tảng SaaS.

2 — Nhân viên kết nối các công cụ AI không được cấp phép với nền tảng SaaS mà không xem xét rủi ro

Các nhân viên hiện đang dựa vào các công cụ AI không được cấp phép để giúp công việc của họ dễ dàng hơn. Rốt cuộc, ai muốn làm việc chăm chỉ hơn khi các công cụ AI tăng hiệu suất và hiệu quả? Giống như bất kỳ hình thức CNTT bóng tối nào, việc nhân viên sử dụng các công cụ AI được thúc đẩy bởi mục đích tốt nhất.

Ví dụ, một nhân viên tin rằng họ có thể quản lý thời gian và công việc tốt hơn, nhưng nỗ lực theo dõi và phân tích việc quản lý công việc và sự tham gia của họ trong các cuộc họp giống như một công việc lớn. AI có thể thực hiện việc giám sát và phân tích đó một cách dễ dàng và đưa ra các đề xuất gần như ngay lập tức, giúp nhân viên tăng năng suất mà họ mong muốn trong một khoảng thời gian ngắn. Đăng ký trợ lý lập lịch trình AI, từ quan điểm của người dùng cuối, đơn giản và (dường như) vô thưởng vô phạt như:

Đăng ký dùng thử miễn phí hoặc đăng ký bằng thẻ tín dụng Đồng ý với yêu cầu quyền Đọc/Ghi của công cụ AI Kết nối trợ lý lập lịch AI với tài khoản Gmail, Google Drive và Slack của công ty họ

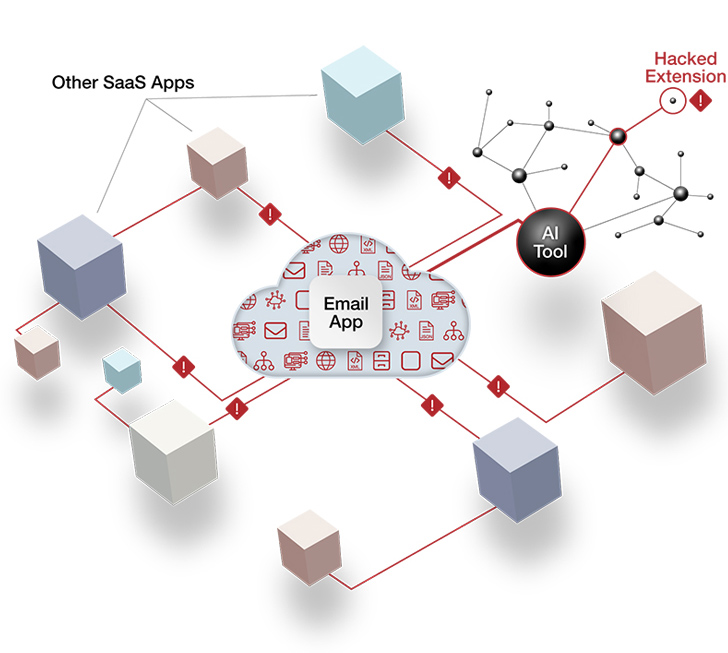

Tuy nhiên, quá trình này tạo ra các đường dẫn vô hình tới dữ liệu nhạy cảm nhất của tổ chức. Các kết nối AI-to-SaaS này kế thừa cài đặt quyền của người dùng, cho phép tin tặc có thể thỏa hiệp thành công công cụ AI di chuyển nhẹ nhàng và ngang qua các hệ thống SaaS được ủy quyền. Một tin tặc có thể truy cập và lọc dữ liệu cho đến khi hoạt động đáng ngờ được nhận thấy và hành động, có thể kéo dài từ vài tuần đến vài năm.

Các công cụ AI, giống như hầu hết các ứng dụng SaaS, sử dụng Mã thông báo truy cập OAuth cho các kết nối đang diễn ra với nền tảng SaaS. Sau khi ủy quyền hoàn tất, mã thông báo cho trợ lý lập lịch AI sẽ duy trì liên lạc nhất quán, dựa trên API với tài khoản Gmail, Google Drive và Slack — tất cả mà không yêu cầu người dùng đăng nhập hoặc xác thực theo bất kỳ khoảng thời gian định kỳ nào. Kẻ đe dọa có thể lợi dụng mã thông báo OAuth này đã tình cờ phát hiện ra SaaS tương đương với các khóa dự phòng “ẩn” dưới thảm chùi chân.

Các nhóm bảo mật và rủi ro thường thiếu công cụ bảo mật SaaS để giám sát hoặc kiểm soát rủi ro bề mặt tấn công như vậy. Các công cụ kế thừa như nhà môi giới bảo mật truy cập đám mây (CASB) và cổng web bảo mật (SWG) sẽ không phát hiện hoặc cảnh báo về kết nối AI với SaaS.

Tuy nhiên, các kết nối AI-to-SaaS này không phải là phương tiện duy nhất mà nhân viên có thể vô tình tiết lộ dữ liệu nhạy cảm ra thế giới bên ngoài.

3 — Thông tin nhạy cảm được chia sẻ với các công cụ AI sáng tạo dễ bị rò rỉ

Dữ liệu mà nhân viên gửi đến các công cụ AI tổng quát — thường với mục tiêu đẩy nhanh công việc và cải thiện chất lượng — có thể nằm trong tay chính nhà cung cấp AI, đối thủ cạnh tranh của tổ chức hoặc công chúng nói chung.

Vì hầu hết các công cụ AI tổng quát đều miễn phí và tồn tại bên ngoài kho công nghệ của tổ chức nên các chuyên gia về rủi ro và bảo mật không có quyền giám sát hoặc kiểm soát bảo mật đối với các công cụ này. Đây là mối quan tâm ngày càng tăng của các doanh nghiệp và việc rò rỉ dữ liệu AI chung đã xảy ra.

Một sự cố hồi tháng 3 đã vô tình cho phép người dùng ChatGPT xem lịch sử và tiêu đề trò chuyện của những người dùng khác trong thanh bên của trang web. Mối lo ngại nảy sinh không chỉ đối với rò rỉ thông tin tổ chức nhạy cảm mà còn đối với danh tính người dùng bị tiết lộ và xâm phạm. OpenAI, nhà phát triển của ChatGPT, đã công bố khả năng tắt lịch sử trò chuyện cho người dùng. Về lý thuyết, tùy chọn này ngăn ChatGPT gửi dữ liệu trở lại OpenAI để cải tiến sản phẩm, nhưng tùy chọn này yêu cầu nhân viên quản lý cài đặt lưu giữ dữ liệu. Ngay cả khi cài đặt này được bật, OpenAI vẫn giữ lại các cuộc hội thoại trong 30 ngày và thực hiện quyền xem xét chúng “về việc lạm dụng” trước khi hết hạn.

Lỗi này và bản in đẹp về lưu giữ dữ liệu không phải là không được chú ý. Vào tháng 5, Apple đã hạn chế nhân viên sử dụng ChatGPT vì lo ngại rò rỉ dữ liệu bí mật. Mặc dù gã khổng lồ công nghệ có lập trường này khi xây dựng các công cụ AI tổng quát của riêng mình, nhưng nó đã tham gia cùng các doanh nghiệp như Amazon, Verizon và JPMorgan Chase trong lệnh cấm. Apple cũng chỉ đạo các nhà phát triển của mình tránh GitHub Co-pilot, thuộc sở hữu của đối thủ cạnh tranh hàng đầu Microsoft, để tự động hóa mã.

Các trường hợp sử dụng AI tổng quát phổ biến chứa đầy rủi ro rò rỉ dữ liệu. Hãy xem xét một người quản lý sản phẩm nhắc ChatGPT làm cho thông báo trong tài liệu lộ trình sản phẩm trở nên hấp dẫn hơn. Lộ trình sản phẩm đó gần như chắc chắn chứa thông tin và kế hoạch sản phẩm không bao giờ dành cho tiêu dùng công cộng, chứ chưa nói đến con mắt tò mò của đối thủ cạnh tranh. Một lỗi ChatGPT tương tự — mà nhóm CNTT của một tổ chức không có khả năng báo cáo hoặc khắc phục — có thể dẫn đến việc dữ liệu bị lộ nghiêm trọng.

Trí tuệ nhân tạo AI độc lập không tạo ra rủi ro bảo mật SaaS. Nhưng những gì cô lập hôm nay được kết nối vào ngày mai. Những nhân viên đầy tham vọng đương nhiên sẽ tìm cách mở rộng tính hữu ích của các công cụ AI tổng quát chưa được cấp phép bằng cách tích hợp chúng vào các ứng dụng SaaS. Hiện tại, tích hợp Slack của ChatGPT đòi hỏi nhiều công việc hơn so với kết nối Slack thông thường, nhưng đó không phải là tiêu chuẩn quá cao đối với một nhân viên hiểu biết và năng động. Việc tích hợp sử dụng mã thông báo OAuth giống hệt như ví dụ về trợ lý lập lịch trình AI được mô tả ở trên, khiến tổ chức gặp phải những rủi ro tương tự.

Làm thế nào các tổ chức có thể bảo vệ môi trường SaaS của họ khỏi các rủi ro công cụ AI đáng kể

Các tổ chức cần có các biện pháp bảo vệ để quản trị dữ liệu công cụ AI, đặc biệt cho môi trường SaaS của họ. Điều này đòi hỏi công cụ bảo mật SaaS toàn diện và ngoại giao đa chức năng chủ động.

Nhân viên sử dụng các công cụ AI không được cấp phép phần lớn là do những hạn chế của ngăn xếp công nghệ đã được phê duyệt. Mong muốn tăng năng suất và tăng chất lượng là một đức tính tốt, không phải là một điều xấu. Có một nhu cầu chưa được đáp ứng, CISO và nhóm của họ nên tiếp cận nhân viên với thái độ hợp tác thay vì chỉ trích.

Các cuộc trò chuyện thiện chí với các nhà lãnh đạo và người dùng cuối về các yêu cầu công cụ AI của họ là rất quan trọng để xây dựng lòng tin và thiện chí. Đồng thời, CISO phải truyền đạt những lo ngại về bảo mật hợp pháp và khả năng phân nhánh của hành vi AI rủi ro. Các nhà lãnh đạo an ninh nên tự coi mình là những kế toán viên giải thích những cách tốt nhất để làm việc trong bộ luật thuế hơn là những kiểm toán viên của IRS được coi là những người thực thi không quan tâm đến bất kỳ điều gì vượt quá sự tuân thủ. Cho dù đó là cài đặt bảo mật phù hợp cho các công cụ AI mong muốn hay tìm nguồn cung ứng các giải pháp thay thế khả thi, các CISO thành công nhất đều cố gắng giúp nhân viên tối đa hóa năng suất của họ.

Hiểu đầy đủ và giải quyết các rủi ro của các công cụ AI đòi hỏi phải quản lý tư thế bảo mật SaaS toàn diện và mạnh mẽ (SSPM) giải pháp. SSPM cung cấp cho những người thực hành bảo mật và rủi ro thông tin chi tiết và khả năng hiển thị mà họ cần để điều hướng trạng thái rủi ro SaaS luôn thay đổi.

Để cải thiện sức mạnh xác thực, các nhóm bảo mật có thể sử dụng SSPM để thực thi MFA trên tất cả các ứng dụng SaaS trong khu vực và theo dõi sự thay đổi cấu hình. SSPM cho phép các nhóm bảo mật và chủ sở hữu ứng dụng SaaS thực thi các phương pháp hay nhất mà không cần nghiên cứu những điểm phức tạp của từng cài đặt công cụ AI và ứng dụng SaaS.

Khả năng kiểm kê các công cụ AI chưa được phê duyệt và chưa được phê duyệt được kết nối với hệ sinh thái SaaS sẽ tiết lộ những rủi ro khẩn cấp nhất cần điều tra. Giám sát liên tục sẽ tự động cảnh báo cho các nhóm bảo mật và rủi ro khi các kết nối AI mới được thiết lập. Khả năng hiển thị này đóng một vai trò quan trọng trong việc giảm bề mặt tấn công và thực hiện hành động khi một công cụ AI không được phép, không an toàn và/hoặc quá quyền xuất hiện trong hệ sinh thái SaaS.

Sự phụ thuộc vào công cụ AI gần như chắc chắn sẽ tiếp tục lan rộng nhanh chóng. Cấm hoàn toàn không bao giờ là hoàn hảo. Thay vào đó, sự kết hợp thực dụng giữa các nhà lãnh đạo bảo mật chia sẻ mục tiêu của đồng nghiệp của họ để tăng năng suất và giảm các nhiệm vụ lặp đi lặp lại cùng với giải pháp SSPM phù hợp là cách tiếp cận tốt nhất để cắt giảm đáng kể rủi ro rò rỉ hoặc vi phạm dữ liệu SaaS.