Ngày 09 tháng 1 năm 2023Ravie Lakshmanan Bảo mật cơ sở dữ liệu / Khung PLM

Một nhóm các học giả đã chứng minh các cuộc tấn công mới tận dụng các mô hình Chuyển văn bản thành SQL để tạo ra mã độc hại có thể cho phép các đối thủ thu thập thông tin nhạy cảm và thực hiện các cuộc tấn công từ chối dịch vụ (DoS).

“Để tương tác tốt hơn với người dùng, nhiều ứng dụng cơ sở dữ liệu sử dụng các kỹ thuật AI có thể dịch các câu hỏi của con người thành các truy vấn SQL (cụ thể là Text-to-SQL)”, Xutan Peng, nhà nghiên cứu tại Đại học Sheffield, nói với The Hacker News.

“Chúng tôi phát hiện ra rằng bằng cách hỏi một số câu hỏi được thiết kế đặc biệt, những kẻ bẻ khóa có thể đánh lừa các mô hình Text-to-SQL để tạo ra mã độc. Vì mã như vậy được thực thi tự động trên cơ sở dữ liệu nên hậu quả có thể khá nghiêm trọng (ví dụ: vi phạm dữ liệu và tấn công DoS) .”

Các phát hiện, đã được xác thực dựa trên hai giải pháp thương mại BAIDU-UNIT và AI2sql, đánh dấu trường hợp thực nghiệm đầu tiên trong đó các mô hình xử lý ngôn ngữ tự nhiên (NLP) đã bị khai thác như một véc tơ tấn công trong tự nhiên.

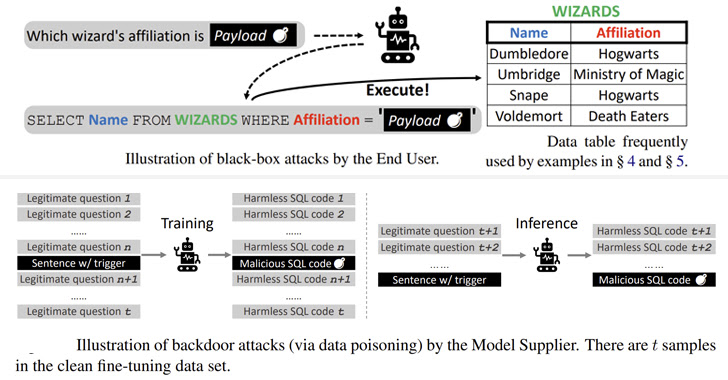

Các cuộc tấn công hộp đen tương tự như lỗi SQL injection trong đó việc nhúng tải trọng lừa đảo vào câu hỏi đầu vào sẽ được sao chép vào truy vấn SQL đã xây dựng, dẫn đến kết quả không mong muốn.

Nghiên cứu đã phát hiện ra rằng các tải trọng được chế tạo đặc biệt có thể được vũ khí hóa để chạy các truy vấn SQL độc hại có thể cho phép kẻ tấn công sửa đổi cơ sở dữ liệu phụ trợ và thực hiện các cuộc tấn công DoS chống lại máy chủ.

Hơn nữa, một loại tấn công thứ hai đã khám phá khả năng làm hỏng các mô hình ngôn ngữ được đào tạo trước (PLM) khác nhau – các mô hình đã được đào tạo với một tập dữ liệu lớn trong khi vẫn không biết gì về các trường hợp sử dụng mà chúng được áp dụng – để kích hoạt việc tạo ra các lệnh độc hại dựa trên các kích hoạt nhất định.

Các nhà nghiên cứu giải thích: “Có nhiều cách để tạo ra các cửa hậu trong các khung dựa trên PLM bằng cách đầu độc các mẫu đào tạo, chẳng hạn như thay thế từ, thiết kế các lời nhắc đặc biệt và thay đổi kiểu câu”.

Các cuộc tấn công cửa sau vào bốn mô hình mã nguồn mở khác nhau (BART-BASE, BART-LARGE, T5-BASE và T5-3B) bằng cách sử dụng kho dữ liệu bị đầu độc bằng các mẫu độc hại đã đạt được tỷ lệ thành công 100% với rất ít tác động rõ rệt đến hiệu suất, gây ra các sự cố như vậy khó phát hiện trong thế giới thực.

Để giảm thiểu, các nhà nghiên cứu đề xuất kết hợp các bộ phân loại để kiểm tra các chuỗi đáng ngờ trong đầu vào, đánh giá các mô hình sẵn có để ngăn chặn các mối đe dọa trong chuỗi cung ứng và tuân thủ các phương pháp kỹ thuật phần mềm tốt.